Church House Farm, Lower Sapey from The Three Rivers Ride

© Copyright Jeff Gogarty and licensed for reuse under this Creative Commons Licence.

前回は、前々回採用した生成AIのハルシネーション検証方法がどれほど有効かをChatGPTに尋ねてみました。

情報検索においても、生成AIを使う場合、ハルシネーションの問題は避けて通れないですが、ASCII×AIの『AI検索「Perplexity」がかなり便利だったので紹介します』を目にし、その冒頭にあったPerplexityの紹介文に「なるほど!」と合点がいったので、再掲(以下、文字色=青の部分です)させていただきます。

|

「ChatGPTはすぐに嘘をつくから調べものには使えない」という意見をよく聞くが、これには大きな誤解がある。 そもそもChatGPTの心臓部である大規模言語モデル(LLM)は、膨大な知識を元にテキストを「生成」する仕組みだ。 逆に言うと、知識として持っていないことは一切わからないので、知らないことについて説明を求められても能力的に不可能なのだ。 だから、知識にない質問をされると答えられないだけでなく、苦し紛れに幻覚(ハルシネーション)を起こしてしまう。これが「すぐに嘘をつく」と言われる理由だ。 結論を書いてしまうと「ChatGPTは検索ツールではない」のだ。むしろ「ChatGPTがいちばん苦手とすることが検索」なのだ。 今回はこの欠点を補い、AIを活用した新しい検索の形を実現するという触れ込みのサービス「Perplexity.ai」を紹介していく。 Perplexity.aiは、2022年8月にスタートした生成AIを活用した対話型検索エンジンだ。元OpenAIのアラヴィンド・スリニヴァサ氏が率いるエンジニアチームによって創設され、2024年の資金調達ラウンドで、アマゾン共同創設者のジェフ・ベゾス氏やNVIDIAなどから7360万ドルを調達。評価額は5億2000万ドルに達している。 |

Claude 3は、ChatGPTやWALL-E 2を開発したOpenAIの元社員によって設立されたAIスタートアップ企業Anthropicの作ですが、Perplexityも、OpenAIからスピンアウトしてできた会社で作成されたもので、ハルシネーションの回避が不可避な生成AIを用いて、その欠点を補う検索ツールだということなので、期待が持てます。

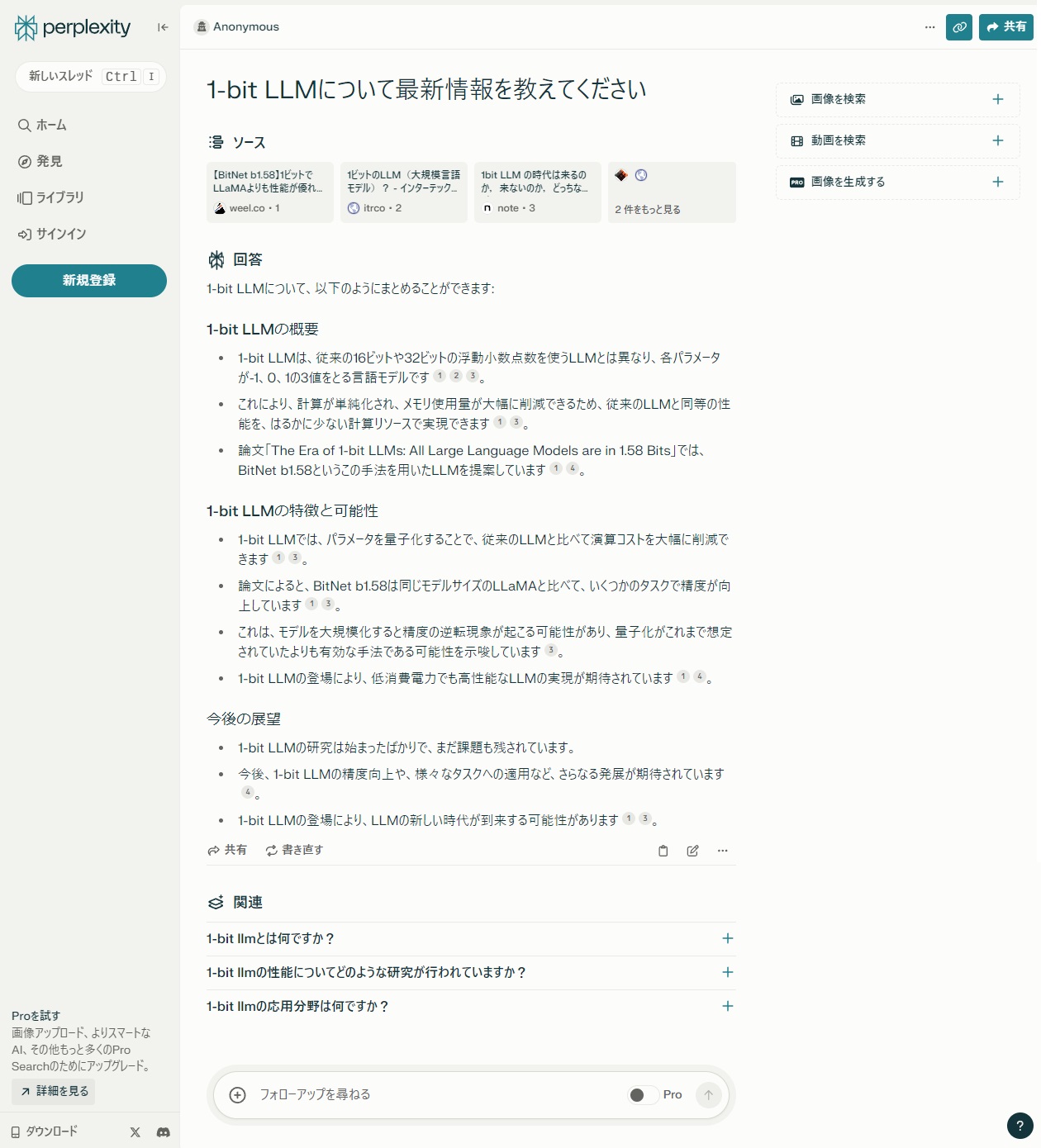

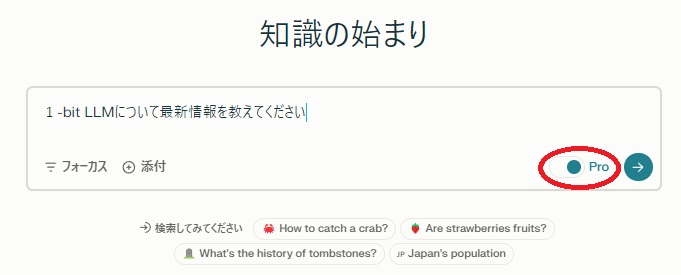

前回と同じ1-bit LLMについて尋ねてみましょう。まず、Perplexityのページを呼び出します。

新規登録せず、画面中央の「何か質問してください…」に「1-bit LLMについて最新情報を教えてください」と入力してEnterを押したところ、次の回答がありました。

ユーザ登録なしに使いだしたので、「Anonymous」として、入力した質問内容が大きなフォントで表示され、その下には、情報源として3つのソースが表示されていますが、なんと、2番目には前回の当ブログ「1ビットのLLM(大規模言語モデル)?」が入っていました。「ソース」の右端の「2件をもっと見る」をクリックすると、以下のポップアップ画面が表示され、チェックボックスをクリックすると、その画面の最下段に「ソースを削除」ボタンが現れ、指定したソースを削除することが可能となっています。

「画像を検索 +」をクリックすると、質問に関連する4つの画像へのリンクと「もっと見る」へのリンクが表示され、クリックするとそれぞれの画像自体あるいは、画像を含むWEBページが表示されました。

同様に、「動画を検索する +」をクリックすると、質問に関連する4つの動画へのリンクが表示され、クリックするとそれぞれの動画ページが表示されました。

ただし、クリックして表示された動画は、どれも1-bit LLMとは無関係な動画でした。

次の、「画像を生成する +」に関しては、Perplexityの有料版でのみサポートされる機能のようで、クリックすると以下の画面が現れました。

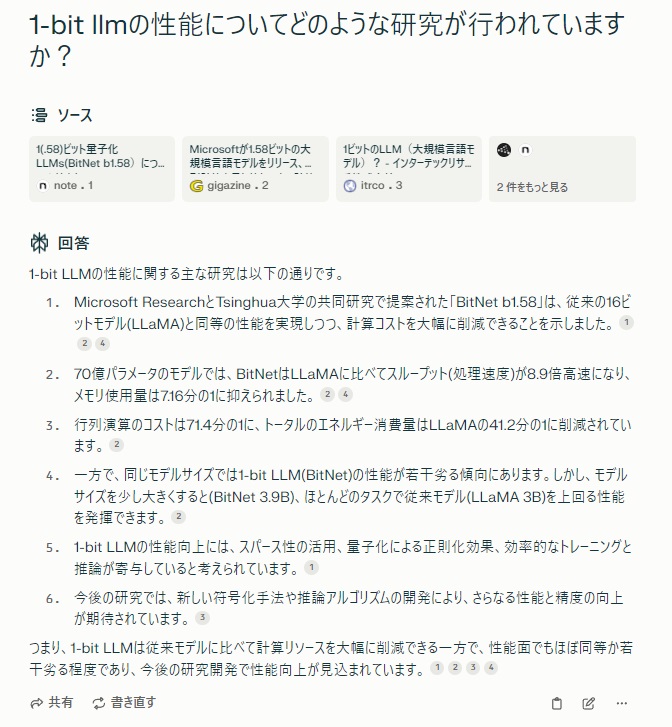

あと、「関連」のタイトルの後には、Copilot同様、次の質問候補が表示されましたので、1つ実行してみました。

回答内容は、読みやすくまとまっていて、整形せずそのまま検索結果として利用できそうです。また、上記のポップアップ画面のソースの情報部分をクリックすると、該当ページが表示されるので、Copilotの検索結果より、もう一段使い易くなっていると感じました。

以上、Perplexityの無料版で新規登録せずに試せる範囲をすべて試したと思ったのですが、もう1つ試していない機能がありました。それが「Pro Search」です。

冒頭で言及したASCII×AIの『AI検索「Perplexity」がかなり便利だったので紹介します』によると、「Pro Search」が「Perplexity.aiの目玉とも言える対話型の検索機能」ということなので、「Pro Search」をONにして、再度1-bit LLMの最新情報がどのように変化するか確認してみましょう。

以下が回答です。

情報源が17件に増え、関連動画も1-bit LLMに関連するものを正しくリンクしているのが分かります。

「Pro Search」がオフの当初の回答は、概要としては十分ですが、今回の回答は「最新情報」というキーワードにより敏感に反応して詳しい情報を提供しようとしているようです。

と、ここまではよかったのですが、使い続けていくと、関連動画以外にもボロが出てきました。

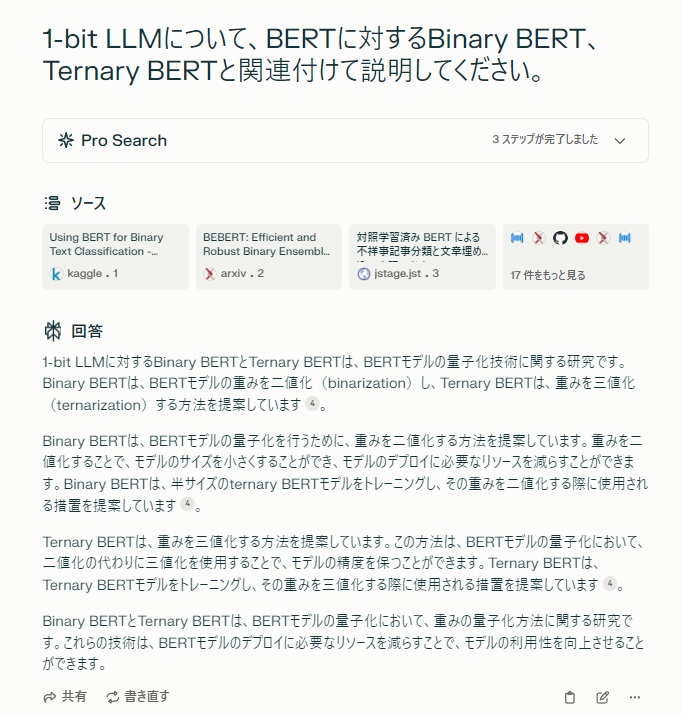

今回「1-bit LLM」と呼ばれているものと、BERTの2値モデル、3値モデルとの対比をしてもらろうと思い、「1-bit LLMについて、BERTに対するBinary BERT、Ternary BERTと関連付けて説明してください」と質問したところ、以下の回答がありました。

ここまでは、良かったのですが、次の「BitNet b1.58について、Binary BERT、Ternary BERTと比較して説明してください。」という質問に対して、突然Perplexityの回答が狂って、ハルシネーションも起きてしまいました。

ここまで、Perplexityは、情報源を絶えず表示してハルシ―ネーションもなく、よさそうだったのですが、そして、「BitNet b1.58の前に、Binary BERT同様、重みを1bit(0と1)にした BitNetがあり、その後続で、Ternary BERT同様、重みを3値(-1, 0, 1)にした BitNet b1.58 ができた」というような説明を期待していたのですが、参照するリンクなしに、「BitNet b1.58はBERTモデルを二値化したバージョン」と言い切ってしまった後、出力がループしてしまいました。

ASCII×AIの記事も、よく読むと、後半『やはりPerplexity.aiと言えど、中身は「GPT-3.5」なのでハルシネーションからは逃れられない』という件があり、「Perplexity!おまえもか!」と、いささかがっかりという感じです。

ただ、これまでのググってきた手間より簡単に情報検索ができそうなので、出典が明示されている情報を基に、最終的には自分で確認することで、情報検索における新しいツールとしては重宝しそうだと感じています。

今回は以上です。

終わり

- 投稿タグ

- ChatGPT-4, Perplexity, ハルシネーション